2020年9月8日—Generation.利用RNN產生一個有結構的物件(structuredobject),像是一首詩或是一篇文章。句子是由『Word』或『Character』所組成,假設你有一個中文 ...,2021年1月24日—要達成這個目的,就要引入注意力機制,也就是我們說的RNNseq2seq+attention。RNNse...

Day 13 DL x NLP 大躍進—— Attention & Transformer

- attention rnn

- acrobat distiller 6 0 繁體

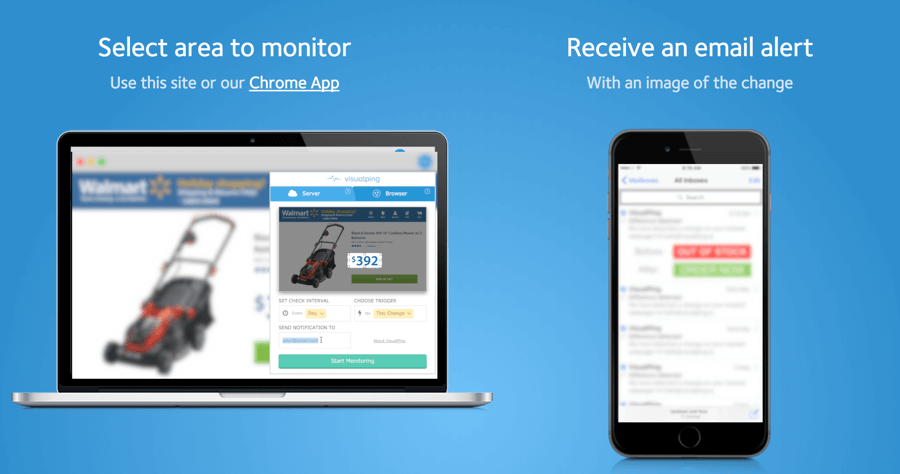

- chrome web page monitor

- distilled

- http distill pub 2016 misread tsne

- distill pub

- activation atlas

- ai experiments

- distill feature visualization

- chrome monitor

- wachete

- distill io

- check4change chrome

- adobe acrobat distiller

- distill pub

- neural network programming

- acrobat distiller 6 0 下載

- acrobat distiller 6 0 繁體

- adobe acrobat distiller

- why momentum really works

- adobe acrobat distiller下載

- attention rnn

- acrobat distiller 6 0 下載

- tsne distill

- distill attention

RNN是deeplearning中最簡單能有效訓練NLPmodel的架構。不過在attention機制和以他為主建立的transformer架構被提出以後,NLP的各項任務在state-of-the-art ...

** 本站引用參考文章部分資訊,基於少量部分引用原則,為了避免造成過多外部連結,保留參考來源資訊而不直接連結,也請見諒 **