attention rnn

2021年7月27日—此篇論文使用Attention改進Seq2seq模型,後來大家發現Attention並不局限於Seq2seq模型,而是可以使用在所有的RNN上。如果僅有一個RNN網路,那麼 ...,2021年5月1日—Attention機制(RNN+Attention).在Encoder-Decoder中,Encoder編碼得到序列特徵c,這組...

L19.3 RNNs with an Attention Mechanism

- attention rnn

- distill attention

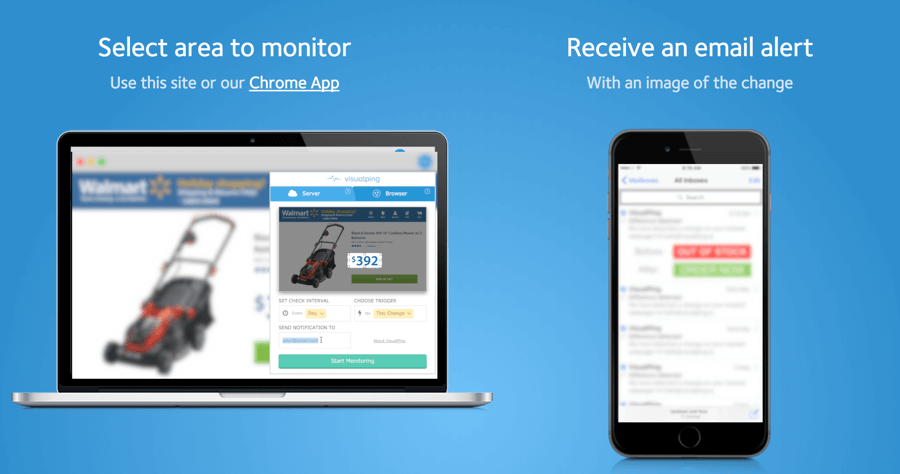

- check4change chrome

- distill pub

- adobe acrobat distiller下載

- attention and augmented recurrent neural networks

- distill pub

- why momentum really works

- distill pub

- distill research

- activation atlas

- wachete

- acrobat distiller 6 0 繁體

- acrobat distiller 6 0

- activation atlas

- exploring neural networks with activation atlases

- google scholar

- distill research

- distilled water

- ai experiments

- adobe acrobat distiller

- feature-wise transformations

- http distill pub 2016 misread tsne

- acrobat distiller 6 0 繁體

- tsne distill

** 本站引用參考文章部分資訊,基於少量部分引用原則,為了避免造成過多外部連結,保留參考來源資訊而不直接連結,也請見諒 **